Il Model Context Protocol (MCP) si sta affermando come una delle innovazioni più significative nel panorama dell’intelligenza artificiale, offrendo una soluzione essenziale a uno dei problemi più persistenti nell’adozione dell’AI: l’integrazione con sistemi e dati esterni.

Cos’è il Model Context Protocol e perché è essenziale

Immaginate un “USB-C per le applicazioni di intelligenza artificiale”. È così che Anthropic, l’organizzazione dietro il modello Claude, descrive il Model Context Protocol. Questo protocollo aperto standardizza il modo in cui le applicazioni AI interagiscono con fonti di dati esterne, strumenti e servizi, eliminando la necessità di integrazioni personalizzate per ogni connessione.

Prima dell’avvento di MCP, ogni nuova fonte di dati o strumento richiedeva la propria implementazione dedicata, creando un ecosistema frammentato di soluzioni ad hoc che complicavano lo sviluppo e ostacolavano l’interoperabilità. MCP affronta direttamente questa sfida, trasformando un problema di complessità M×N (dove M sono i modelli e N gli strumenti da integrare) in una configurazione più gestibile N+M attraverso un protocollo unificato.

La potenza di questo approccio risiede nella sua capacità di semplificare drasticamente lo sviluppo di applicazioni AI avanzate, permettendo agli sviluppatori di concentrarsi sull’innovazione piuttosto che sulle complessità dell’integrazione.

L’architettura del MCP: Host, Client e Server

Il cuore del protocollo MCP è una robusta architettura client-server composta da tre componenti fondamentali:

- Host MCP: L’applicazione AI principale (come Claude Desktop) che avvia le connessioni ai Server e coordina l’interazione complessiva. L’Host gestisce i permessi, applica le politiche di sicurezza e aggrega il contesto tra i vari Client.

- Client MCP: Risiede all’interno dell’Host e mantiene una connessione uno-a-uno con un Server. È responsabile dell’invio di richieste, della gestione delle risposte e del ciclo di vita della comunicazione.

- Server MCP: Un programma esterno che implementa lo standard MCP e fornisce specifiche capacità, come l’accesso a risorse di dati o l’esposizione di strumenti eseguibili.

Questa struttura gerarchica garantisce un controllo granulare sull’accesso alle risorse e mantiene chiari confini di sicurezza, elementi vitali per applicazioni enterprise che manipolano dati sensibili.

Le primitive fondamentali del protocollo

MCP opera attraverso un linguaggio comune di “primitive” che definiscono le interazioni possibili:

- Prompt: Istruzioni o modelli preparati che guidano il modello AI

- Risorse: Dati strutturati che arricchiscono il contesto del modello

- Strumenti: Funzioni eseguibili che il modello può invocare tramite il Server

- Radici: Punti di accesso al filesystem o all’ambiente dell’Host

- Campionamento: Meccanismo che permette al Server di richiedere un completamento all’AI host

Questo ricco insieme di primitive va ben oltre le semplici chiamate di funzione, permettendo interazioni più sofisticate e contestuali tra modelli AI e sistemi esterni.

MCP in azione: Applicazioni pratiche

Il potenziale di MCP si materializza già in diverse implementazioni concrete che stanno rivoluzionando il modo in cui interagiamo con l’intelligenza artificiale.

Implementazioni su sistemi desktop

Claude Desktop rappresenta la prima implementazione consumer di MCP, permettendo all’assistente AI di accedere in modo sicuro a file, applicazioni e servizi locali. Gli utenti possono configurare server MCP per consentire a Claude di leggere e scrivere file sul filesystem locale, effettuare ricerche sul web tramite Brave Search o interagire con repository Git.

Questa capacità trasforma radicalmente l’utilità degli assistenti AI, portandoli da semplici chattbot a veri e propri collaboratori in grado di operare nel contesto del sistema locale dell’utente.

Automazioni AI con MCP e n8n

Uno degli sviluppi più entusiasmanti è l’integrazione di MCP con piattaforme di automazione come n8n e Make. Questa sinergia apre scenari sorprendenti per l’automazione guidata dall’intelligenza artificiale.

Per n8n, sono stati sviluppati nodi personalizzati che permettono di interagire direttamente con i server MCP, mentre per Make è disponibile un server MCP che consente a Claude Desktop di comunicare con gli scenari di automazione. Gli sviluppatori possono così creare flussi di lavoro in cui gli assistenti AI orchestrano automaticamente processi complessi attraverso comandi in linguaggio naturale.

Immaginate di chiedere semplicemente: “Estrai i dati dal mio CMS Drupal, analizzali e invia un rapporto via email” – e vedere l’assistente AI eseguire l’intero flusso di lavoro attraverso n8n senza ulteriori input.

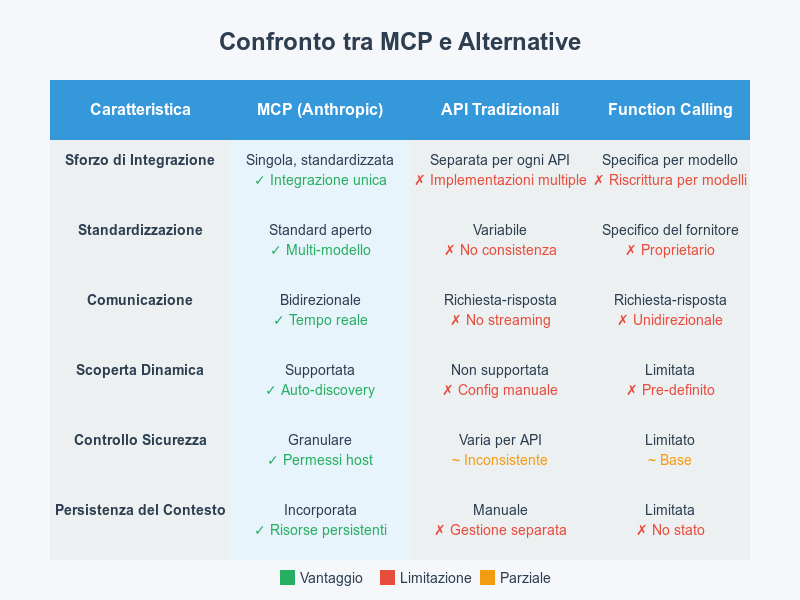

Vantaggi strategici del MCP rispetto alle alternative

MCP si distingue nettamente dalle soluzioni alternative per diversi aspetti chiave:

- Rispetto alle API tradizionali: MCP offre un’integrazione singola e standardizzata, eliminando la necessità di implementazioni separate per ogni API. Supporta inoltre comunicazione in tempo reale e scoperta dinamica di funzionalità.

- Rispetto a “Work with Apps” di OpenAI: MCP è una soluzione universale e open-source, contrariamente alla natura proprietaria e limitata dell’offerta di OpenAI.

- Rispetto al function calling: Mentre il function calling traduce il linguaggio naturale in comandi specifici, MCP standardizza il modo in cui tali comandi vengono eseguiti attraverso diversi sistemi, offrendo anche la capacità di mantenere lo stato tra le interazioni.

Questa combinazione di apertura, standardizzazione e ricchezza funzionale rende MCP una soluzione particolarmente attraente per organizzazioni che cercano interoperabilità e flessibilità nei loro ecosistemi AI.

Il futuro dell’integrazione AI con MCP

La standardizzazione offerta da MCP promette di trasformare profondamente il panorama dell’integrazione AI. Se dovesse ottenere un’ampia adozione, potremmo assistere a un futuro in cui modelli e strumenti AI diventano largamente interoperabili.

Le organizzazioni potrebbero creare suite di server MCP per i propri sistemi interni, e qualsiasi modello AI che supporti MCP potrebbe connettersi immediatamente a tali suite. Questo disaccoppiamento tra modello e integrazioni permetterebbe alle aziende di sostituire o aggiornare il proprio modello linguistico senza dover rifare tutti i connettori per dati e azioni.

L’abbattimento delle barriere d’ingresso per gli sviluppatori potrebbe inoltre portare a una proliferazione di soluzioni AI innovative in vari domini, simile a quanto avvenuto con l’adozione di standard come HTTP per il web.

Per le aziende che guardano al futuro dell’automazione intelligente, MCP rappresenta una tecnologia da monitorare attentamente e potenzialmente da adottare nelle proprie strategie di sviluppo digitale.

Che si tratti di assistenti AI desktop più capaci, automazioni guidate dal linguaggio naturale o ecosistemi aziendali più coesi, il Model Context Protocol sta aprendo la strada a un nuovo capitolo nell’evoluzione dell’intelligenza artificiale: quello in cui l’AI diventa finalmente un partner pienamente integrato nei nostri flussi di lavoro digitali.